iFairy团队 投稿

量子位 | 公众号 QbitAI

首个复数大模型!北大提出2比特超低比特量化算法。

现如今,大模型在推理时通常都非常耗存储和计算,这是因为权重采用FP16存储,占用空间大。

北大团队首次提出iFairy方案,把模型权重量化到复数集合 {+1, -1, +i, -i}。

这四个值刚好可以用2比特表示,相当于压缩到原本的1/8。

推理时,复数与{±1,±i}相乘,不需要真正做乘法,只需加减或交换数据位置,计算成本更低。

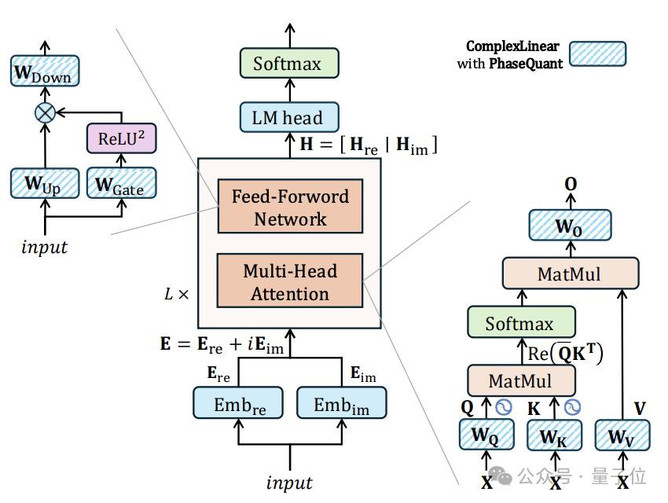

研究团队还将整个Transformer架构都进行了“复数化”改造。

结果显示,iFairy模型取得了比全精度(FP16)LLaMA基座模型更低的困惑度(PPL),降幅高达10%,语言建模能力和下游任务表现反超其全精度的LLaMA基座模型,让GPT-5这样的大模型也有在手机上运行的可能。

目前,相关论文及代码全面开源,人人都能复现训练。

研究核心:模型体积压缩与全新量化算法PhaseQuant

为追求更高的模型性能,业界普遍做法是不断堆叠参数量,模型部署成本高昂。

同时,庞大的参数量带来了计算量的激增,尽管学界和业界已涌现出如gpt-oss的MXFP4训练等优秀的量化方案,但其核心计算逻辑依然没有消除对硬件资源消耗巨大的“乘法”运算的依赖,推理延迟没有实现根本性的降低。

北大团队的iFairy超低比特量化方案为此破局。

模型体积极致压缩,仅为原1/8

在“空间”上,iFairy实现了极致的压缩。

传统的全精度(FP16)权重需要16比特,而iFairy方案仅用2比特,就完成了对一个权重信息的编码。

这意味着,相较于流行的FP16模型,其模型体积可以直接压缩至原来的1/8。这种极致的压缩率,为大模型在手机、汽车等边缘设备上的部署扫清了存储障碍。

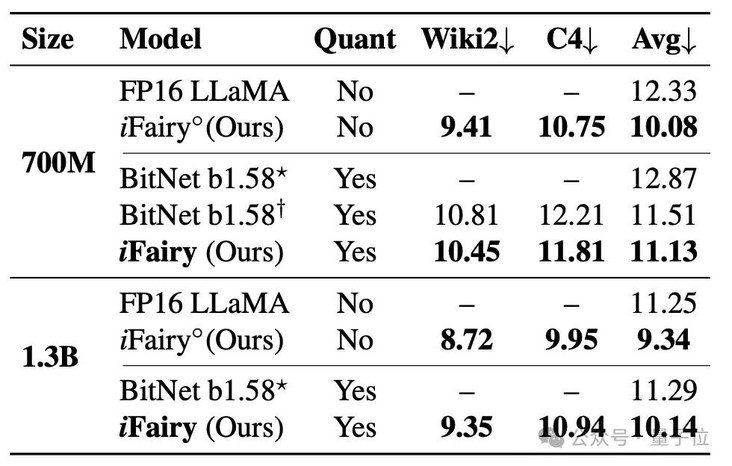

PhaseQuant实现“无乘法”计算

在“时间”上,团队提出全新量化算法PhaseQuant,iFairy实现“无乘法”计算。

PhaseQuant算法

这一切,都源于团队提出的全新量化算法PhaseQuant。它不再将权重映射到实数轴上的点,而是基于参数的相位将其映射到复平面上的四个单位根{+1, -1, +i, -i}。

△PhaseQuant量化算法示意图

这一操作一举多得:

- 信息密度:用 {+1, -1, +i, -i}四个值,彻底利用了2-bit的全部信息容量,信息熵从传统三元量化(如BitNet b1.58)的log₂(3)≈1.58-bit,提升到满格的log₂(4)=2-bit。

- 对称性:这四个点在复平面上关于原点中心对称,保持了模型训练所需的良好性质。

- 稀疏性:每个量化后的复数权重,其实部或虚部必有一个为零,这在高维度上保留了稀疏性的优势。

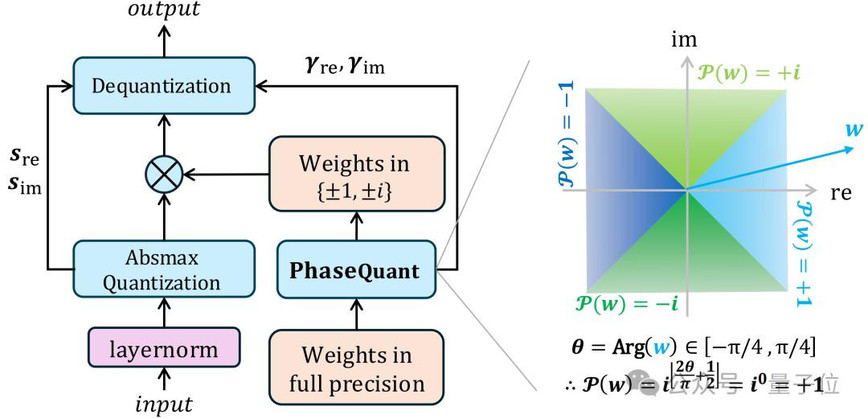

“无乘法”运算

一个标准的复数乘法(a+ib)(c+id)需要4次实数乘法和2次加法,计算量不小。

但在iFairy模型中,当一个复数激活值与量化后的权重{±1, ±i}相乘时,运算发生变化:所有乘法都消失了。

△超低比特复数运算规则

整个模型中最核心、最庞大的矩阵乘法(GEMM),被彻底重构。

原本昂贵的浮点乘法运算,被完全替换为硬件成本几乎为零的加法、减法和数据交换(shuffle)操作。这从根本上消除了计算瓶颈,为实现数量级的推理加速提供了可能。

架构革新:一个全面“复数化”的Transformer

研究团队还将整个Transformer架构都进行了“复数化”改造。

△Fairy±i模型主干

复数注意力机制:传统注意力计算Q和K的点积,这里则巧妙地使用了Hermitian内积的实部作为相似度分数,既利用了所有复数信息,又自然地得到了实数分数用于Softmax。

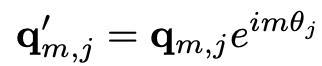

复数旋转位置编码(RoPE):在复数域,位置编码的旋转操作变得异常简洁和统一,一个简单的复数乘法即可实现。

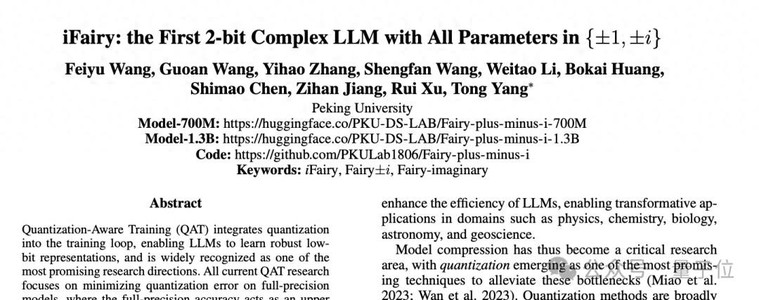

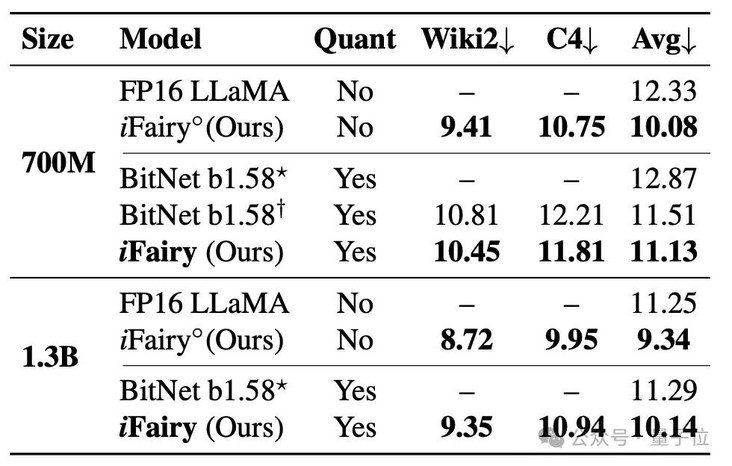

性能表现:PPL降低10%,性能反超全精度

结果显示,iFairy不仅没有出现超低比特量化常见的性能悬崖,反而实现了性能反超。

在LLM的语言建模能力方面,模型的困惑度(PPL)越低,代表模型对文本的理解和预测能力越强。在对PPL的测试中,基于相同数据集训练(注:为保证对比的严谨性,所有对比模型的训练数据均保持一致,具体信息可参见论文)的2-bit的iFairy模型取得了比全精度(FP16)模型更低的困惑度(PPL),降幅高达10%。

△iFairy PPL评测结果

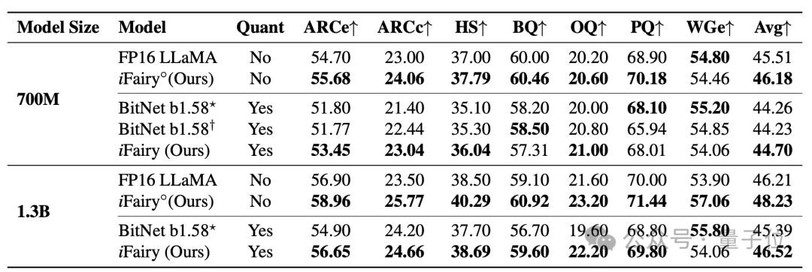

在下游任务评测方面,iFairy模型更是在多个任务的评分反超了全精度的Llama基座模型。

△iFairy 下游任务评测结果(zero-shot)

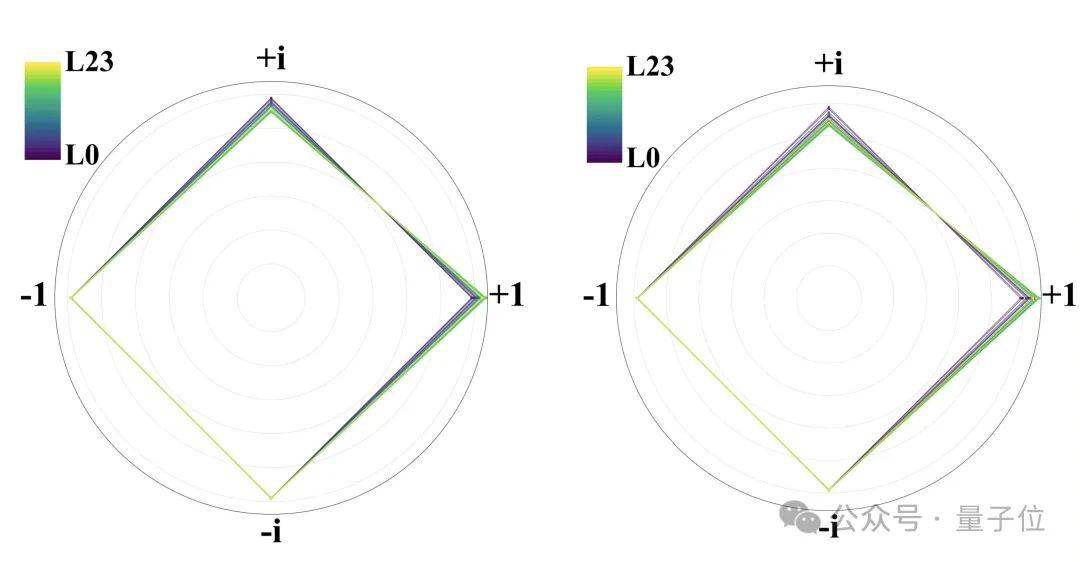

对量化后权重的分析还发现,模型在训练后,这四个复数值{±1, ±i}的分布非常均匀,证明模型确实学会了充分利用这套全新的“编码系统”。

△左为iFairy模型k_proj的参数分布,右为iFairy模型o_proj的参数分布

这项工作将复数神经网络的思想与超低比特量化相结合,通过利用“相位”这一被忽略的信息维度,在不增加任何存储成本的前提下,显著提升了模型的表达能力和最终性能。

或许,我们离在普通手机上流畅运行GPT-5级别的模型,又近了一步。相关论文、训练代码、模型权重与实验脚本已全部开源,配套提供从训练、评测到可复现实验的完整流程,人人皆可复现训练。

论文链接:https://arxiv.org/pdf/2508.05571

huggingface链接:

https://huggingface.co/PKU-DS-LAB/Fairy-plus-minus-i-700M,https://huggingface.co/PKU-DS-LAB/Fairy-plus-minus-i-1.3B

github链接:https://github.com/PKULab1806/Fairy-plus-minus-i

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态