VistaWise团队 投稿

量子位 | 公众号 QbitAI

在大多数人眼中,《我的世界》(Minecraft)只是一款自由度极高的沙盒游戏。

而在香港科技大学(广州)与腾讯联合团队的眼中,它却是一座可以演练通用人工智能的“数字练兵场”。

为了用“小数据办大事”,研究团队提出VistaWise框架,首次将“跨模态知识图谱+轻量化视觉微调”系统性引入开放世界智能体。

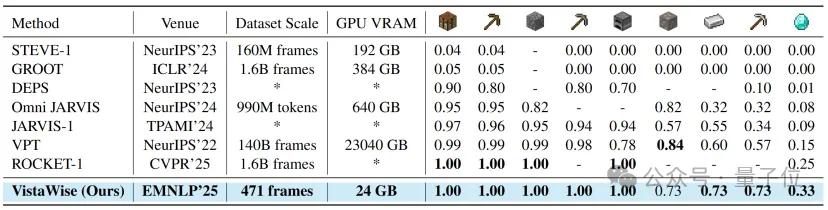

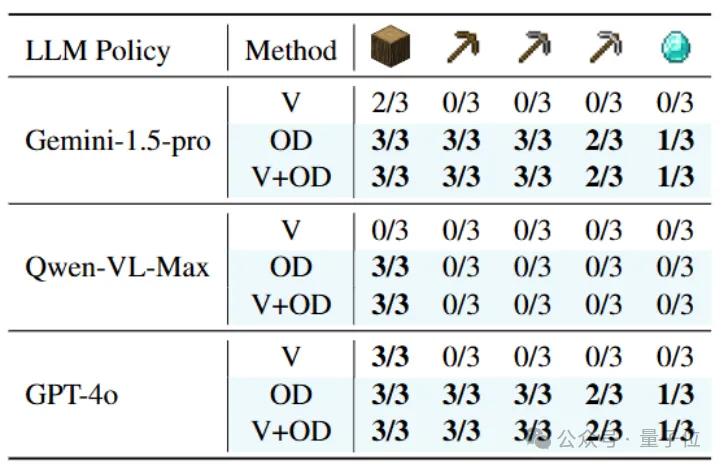

实验结果显示,在“获取钻石”完整链条上,VistaWise以33%成功率刷新非API类方法纪录,较前SOTA提升8个百分点,9个连续子任务全部达到73%以上的成功率。

近日,由双方共同完成的成果被自然语言处理领域顶级会议EMNLP 2025主会正式录用。

VistaWise:图谱“外挂”,四两拨千斤

随着大模型在游戏、数字孪生、线上运营等场景的落地,腾讯发现:要让AI在复杂开放世界中自主决策,传统做法需要千万级标注样本与数百张高端显卡,训练成本动辄百万。

在此背景下,港科大(广州)团队提出“视觉专家微调+外挂知识库”的极简路线:

1、仅采集471张游戏画面,用一张24G显存的消费级显卡即可完成视觉专家模型微调,完整框架可直接部署在笔记本电脑上;

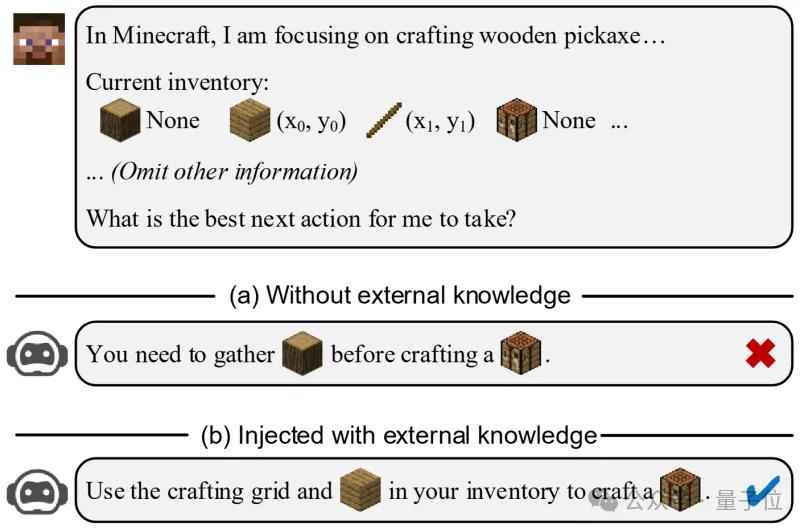

2、将文本攻略、百科知识构建成轻量化知识图谱,实时注入大模型,显著降低幻觉;

3、设计“检索式图池化”机制,让大模型在毫秒级时间内精准锁定任务所需信息。

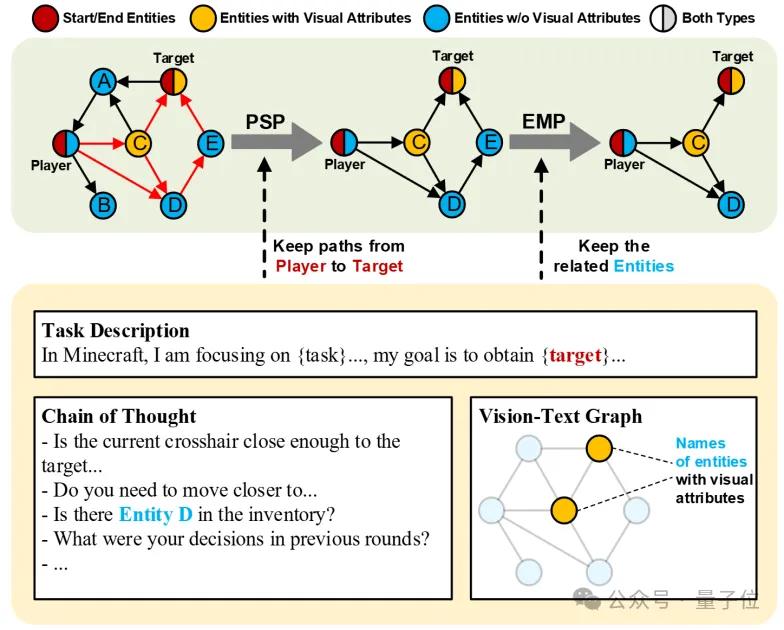

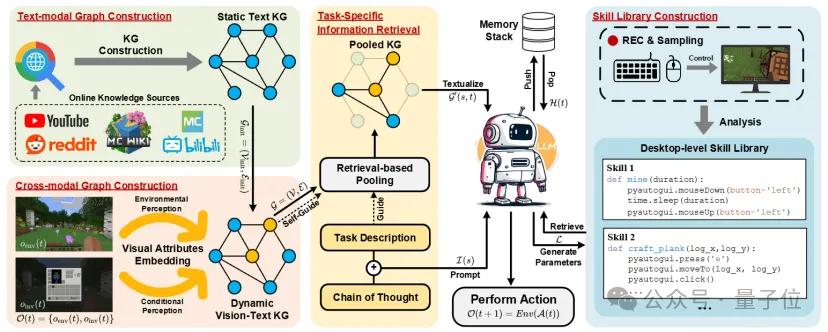

VistaWise以“低成本 + 跨模态”为突破口,提出一套“图-检-控”三位一体的极简框架,核心创新可概括为“一图谱、两增强、三协同”:

图谱级知识外挂

首次将开放世界的文本攻略与实时视觉感知融合成“跨模态知识图谱”。图谱仅保留实体名称与关系,剔除冗余描述,单张1080p画面即可在20 ms内完成动态更新。

视觉增强的轻量化检测

仅使用471张截图微调YOLOv10-L,实现多类游戏实体的像素级定位;引入“经验阈值”距离估计,用像素宽高代替深度估计网络,节省算力的同时减少推理延迟。

推理增强的检索式池化

设计Path-Searching+Entity-Matching双阶段池化,先锁定“玩家→目标”全局路径,再按任务提示与视觉属性局部裁剪以去除冗余信息,减少30%推理tokens。

控制增强的桌面级技能库

基于PyAutoGUI封装多个原子动作函数,支持键鼠混合输入,让大模型直接生成带参调用,摆脱MineFlayer等API束缚,实现“零仿真”真机操作。

VistaWise的决策闭环可抽象为“感知-检索-推理-执行”四步:

- 感知:YOLO同时检测环境与物品面板,输出实体坐标、尺寸及类别;

- 检索:将感知结果实时写入知识图谱,触发双阶段池化,得到任务相关的子图;

- 推理:GPT-4o基于任务描述、子图、记忆栈与技能库,生成“下一步动作+参数”的自然语言指令;

- 执行:指令映射为PyAutoGUI调用,驱动Minecraft客户端完成点击、拖拽、合成等操作,并实时刷新环境与记忆。

整套系统仅依赖单张24 GB GPU完成训练,推理阶段完全在本地配备8 GB显卡的笔记本电脑上闭环运行。

小数据撬动大模型,性能与成本双破纪录

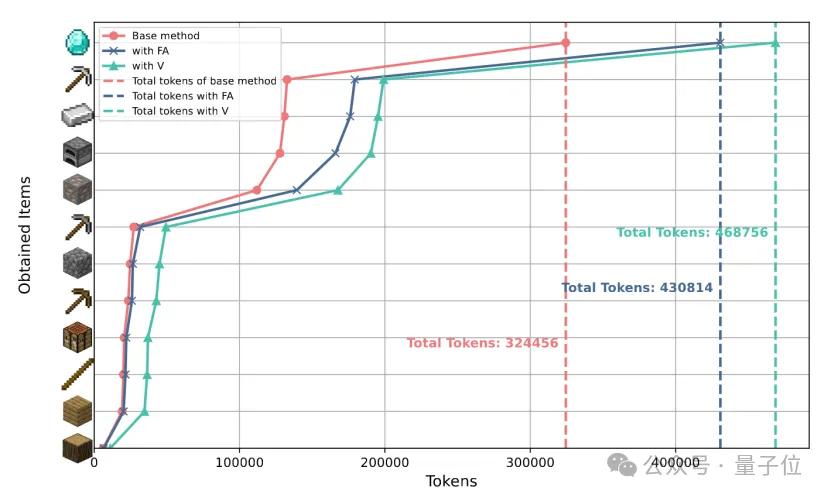

实验结果表明,VistaWise训练数据量可缩减5个数量级(471 vs 160M帧),GPU显存需求下降87.5%(24 GB vs 192 GB)。

不仅如此,与使用多模态大模型 (MLLM) 进行视觉感知相比,VistaWise使用轻量化视觉检测和检索式池化可减少冗余信息,在实现了更高性能的同时降低了30.7%的tokens使用,而性能并未出现明显下降。

在“获取钻石”完整链条上,使用GPT-4o进行推理,最终开销仅为Voyager的5%($1.28 vs $25)。

作者信息:

王浩,通讯作者,香港科技大学(广州),人工智能学域助理教授、博士生导师。

2023年博士毕业于新加坡南洋理工大学,曾在TikTok、地平线等公司科研工作。主要研究兴趣为大模型生成式智能体和三维重建。

发表TPAMI、IJCV、CVPR、NeurIPS等领域顶级会议期刊论文50余篇。主持国家自然科学基金青年项目,参与国家科技部国家重点研发计划项目,获2023年SMP-IDATA晨星青年基金、2024年腾讯犀牛鸟专题项目。

论文链接:https://arxiv.org/abs/2508.18722

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态