在启动模型微调之前,最常见也最现实的问题往往是:显存够不够?训练要花多长时间?租的这块卡能不能撑得住?

希望你读完这篇文章之后,面对这些问题,能有一个清晰、可计算的判断依据,而不是凭感觉决策。

本文中的所有计算示例,均基于以下训练参数设定:

- 模型规模:7B参数模型(如LLaMA-7B)

- 精度:FP16(默认训练精度)

- 微调方式:全参数微调(FullFine-Tuning)

- 训练任务:监督微调(SFT)

- 数据量:10,000条

- 每条样本:约1024token

- batchsize:32

- epoch数:3

如无特殊说明,后续计算均默认采用上述参数。

一、训练资源总成本公式

我们将资源消耗拆解为两个关键部分:

训练资源总成本(¥) ≈ (显存使用、训练时长)而决定的你要购买/租用的GPU价格

显存使用和训练时间又分别可细化为:

- 显存使用≈固定显存使用+动态显存使用

- 训练时间≈每step耗时×step数×重试系数

理解了这个公式,也就掌握了训练资源估算的核心框架。

二、公式拆解与计算方法

1. 固定显存

固定显存指的是模型结构本身在训练过程中始终占用的部分,主要包括模型参数、梯度缓存和优化器。

全参数微调时,固定显存大致为:

- 固定显存≈模型参数本身大小+梯度缓存+优化器

- 梯度缓存≈模型参数本身大小

- 优化器≈2倍梯度缓存

- 固定显存≈模型大小×4(在FP16精度下)

以一个 7B 模型为例:

模型本体:7B(70亿参数) × 2 字节(因为精度是FP16) ≈ 14GB

- 梯度缓存:约14GB

- 优化器状态:约28GB

- 固定显存总计约56GB

2. 动态显存

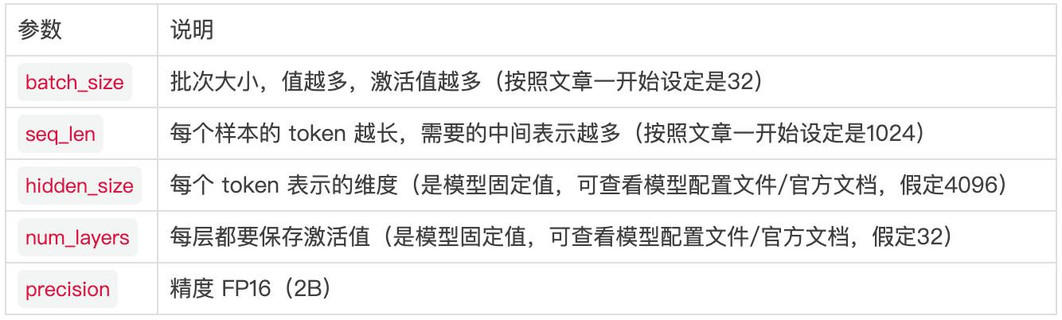

动态显存主要来自训练过程中的中间激活值缓存,其大小受多个超参数影响,估算公式如下:

动态显存 ≈ batch_size × seq_len × hidden_size × num_layers × precision

动态显存 ≈ 32 × 1024 × 4096 × 32 × 2 字节 ≈ 9GB

这个部分会随着 batch size 和序列长度成比例增长,因此在资源紧张时,优先通过减小 batch size 控制显存使用。

3. 总显存需求

将固定显存和动态显存相加:

总显存 ≈ 56GB + 9GB ≈ 65GB

所以得出最终训练一次 “step”至少要用显存 65GB

4. 训练步数(step 数)

训练步数取决于训练集大小、batch size 和 epoch 数:

step 数 = 数据条数 ÷ batch_size × epoch

例如:

- 数据条数:10,000(按照文章一开始设定)

- batch_size:32(按照文章一开始设定)

- epoch:3(按照文章一开始设定)

计算得:

- 每个epoch:10,000÷32≈313step

- 总步数:313×3=939step

5. 每 step 耗时

每步训练的耗时受硬件、模型大小、数据加载速度等因素影响。根据经验训练一个中等规模模型,每 step 耗时大约为 1~2 秒。

按平均 1.5 秒计算,总训练时间为:

训练时间 ≈ 939 × 1.5 秒 ≈ 1,408 秒 ≈ 23 分钟

考虑到验证集评估、checkpoint 存储等过程,建议按 1~2 小时准备训练窗口。

6. 重试系数

训练过程往往伴随多次试错。常见问题包括:

- 数据格式不规范

- 超参数设置错误

- 模型loss不下降

- 中途中断或显存溢出

因此应为训练时间乘以一个保守的重试系数,推荐范围为 2~3。

最终训练时间估算为:

实际训练时间 ≈ 理论时间 × 重试系数

以此例为参考,预计需要准备 2~3 小时 GPU 时长,先按3小时计算。

三、资源需求已知后,GPU怎么选?预算怎么算?

先回顾一下我们最开始提到的总公式:

训练资源总成本(¥)≈(显存使用、训练时长)而决定的你要购买/租用的GPU价格

通过前面的计算,我们已经得出两个核心指标:

- 显存需求约为65GB

- 完整训练(最终版)预估耗时约3小时(含约3次试错和验证)

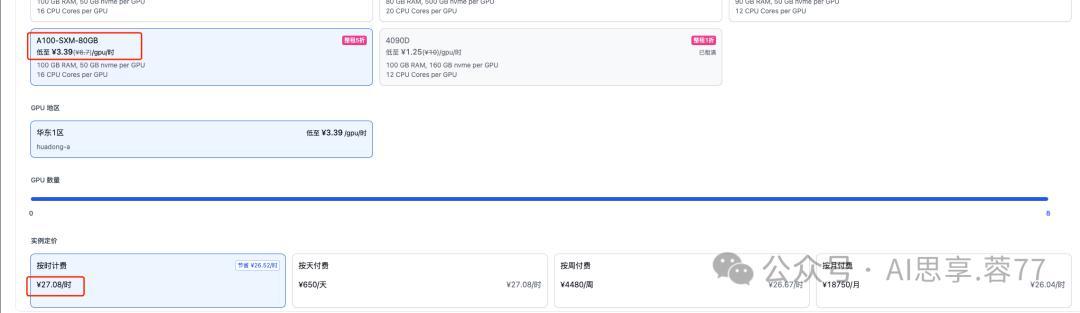

接下来,我们可以基于这个需求,来看一下在实际环境中——例如阿里云平台——租用相应 GPU 所需的成本。

看到这,即使不是会有疑问:单张显卡的显存不够,比如 V100 如图最高只有 32GB,那是不是可以买多张 GPU 拼成大显存?或者一定得用一张 A100 80G 这样的卡?

答案是:多个 GPU 的显存不能直接拼接成“大显存”使用。

原因如下:

- 显卡的显存是物理隔离的,每张GPU管理自己的内存空间

- 程序运行时,默认只能访问当前所绑定那张卡的显存

- 因此,你不能在不借助额外技术的情况下,把一个需要65GB显存的模型“拆开”加载到几张卡上去跑

所以,如果你要训练的是一个 7B 级别的大模型,全参数微调显存需求在 65GB 左右,就只有两个可行方案:

1、使用单卡大显存显卡,比如 A100 80GB,能一次性加载并训练整个模型

2、使用模型并行技术,借助深度学习框架(如 DeepSpeed、Megatron-LM、Colossal-AI 等)手动将模型拆分、分布到多张显卡上

在实际工程中,大多数人会选择第一种方式,因为配置和调度相对简单,失败率更低。如果你不是熟悉多卡训练框架,强行拼显存反而更容易踩坑。

所以最终我们以 A100 的价格为例来做一个简单估算:

按27.08 元/小时 × 3 小时 ≈ 81.24 元。

如果试错次数不多,经验充足的情况下,全参数微调一个 7B 模型、1 万条数据的训练任务,纯算力成本大概在 100 元以内。

当然,这里只计算了显卡资源的开销。实际成本还包括数据准备(可能是最大的工作量)以及人力投入,这些在生产环境中同样不可忽视。

尽管如此,当你看到这个最终成本,其实就会发现:大模型微调并不总是遥不可及。

面对一些特定领域、规模适中的任务,所需的训练参数和资源是可以被合理控制的。只要掌握了基本的资源估算方法,就可以根据实际需求和预算,在可控范围内尝试落地一次真正有价值的微调训练。

这一步,可能比你原先想象的更近,也更可行。

本文由 @AI思·享@蓉77 原创发布于人人都是产品经理。未经作者许可,禁止转载。

题图来自 Unsplash,基于CC0协议。

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。